解开Kubeflow管道的神秘面纱第一部分:Kubernetes上的数据科学工作流程

by liam zheng on 3 September 2020

Kubeflow管道(Pipeline)是构建可移植、可扩展的机器学习工作流程最好的方式,也是更大的Kubeflow生态的一部分,旨在减少大规模训练和部署机器学习模型的复杂性和时间。

在这个系列的博客文章中,我们将介绍Kubeflow pipelines和展示了这种方法来产生可重用和可再现的数据科学。 🚀

我们将探讨为什么Kubeflow为数据科学工作流程带来了正确的标准化,然后说明了如何通过Kubeflow管道实现这一目标。

在第二部分种,我们将开始上手实践。我们也会利用Fashion MNIST数据集和基础Tensorflow示例,采用逐步方法将示例模型转换为Kubeflow管道,以便你可以执行此操作。

为什么要用Kubeflow

机器学习工作流程可能涉及许多步骤,并且如要保存所有这些步骤到笔记本或脚本中将会变得难以维护,共享和协作,这导致大量“机器学习系统中隐藏的技术债务”。

另外,这些步骤通常在不同的系统上运行。在实验的初始阶段,数据科学家将在工作站或本地训练平台上工作,大规模训练通常会在云环境(私有,混合或公有云)中进行,而推理和分布式训练则经常发生在边缘端。

容器提供了正确的封装,避免了每次开发者改变执行环境时调试的需求,且Kubernetes将容器的调度和编排带到了基础设施中。

然而,管理Kubernetes顶端的机器学习工作流程仍然是一项专门的运营工作,这也是我们不想给数据科学家添加的工作。Kubeflow弥补了在AI工作负载和Kubernetes间的间隔,使得机器学习运营更好管理。

什么是Kubeflow管道?

Kubeflow管道是Kubeflow最重要的功能之一,有望使您的AI实验具有可重复性,可组合性。例如,可互换的组件,可扩展,并且易于共享。

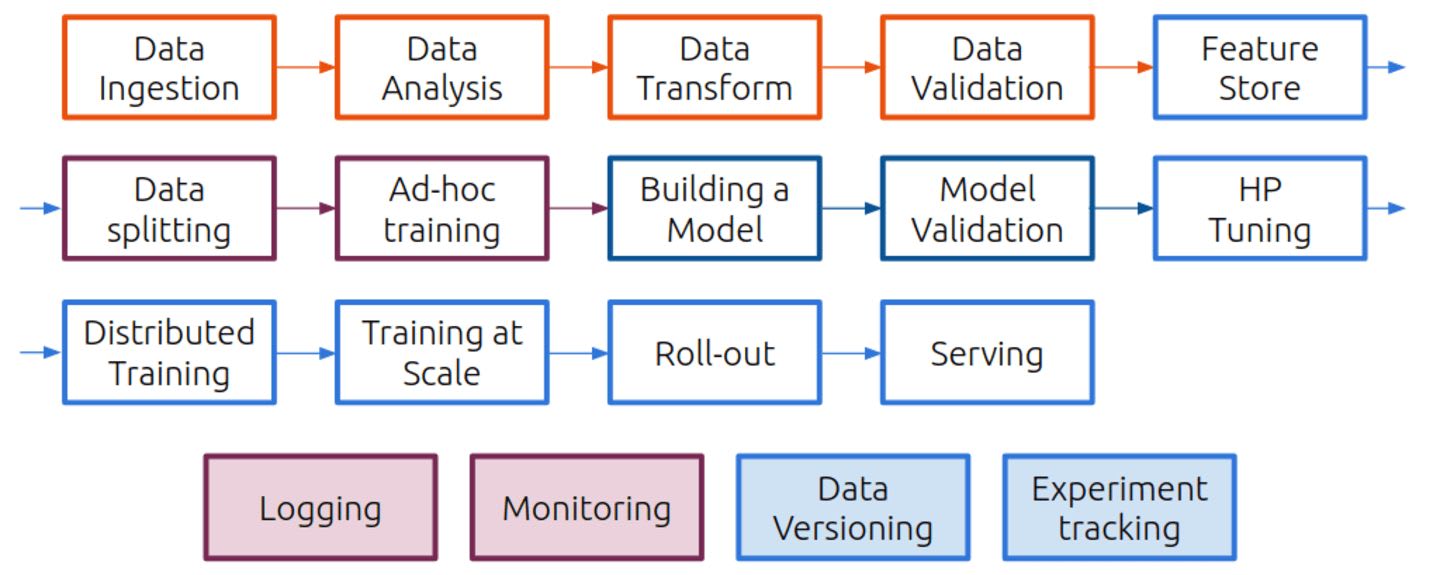

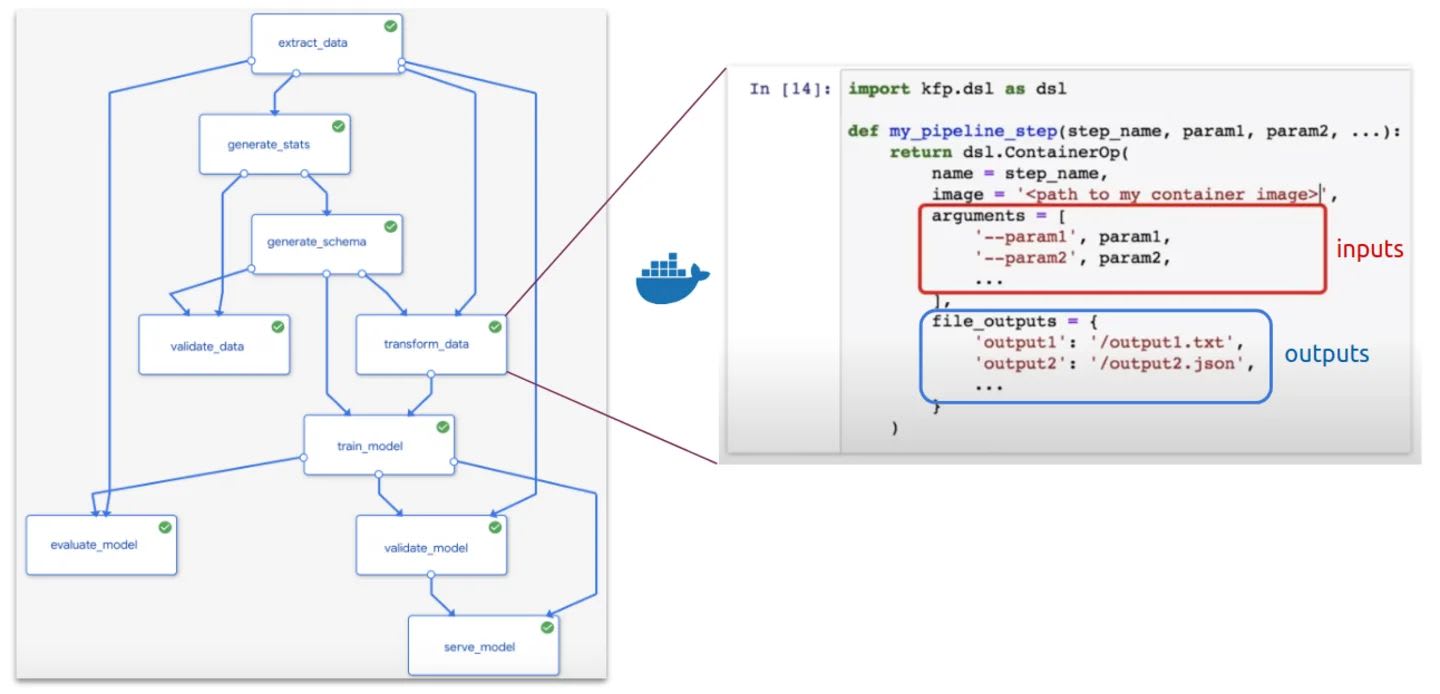

管道是机器学习工作流程的统一表示形式,类似于第一幅图中描述的步骤序列,其中包括工作流程的组件及其各自的依存关系。具体地说,管道是有向无环图(DAG),每个节点上都有一个容器化过程,该过程在Argo之上运行。

每个管道组件,呈现为一个区块,是一个独立的代码,通常打包为Docker镜像。它包含输入(参数),输出和管道中执行的一步。在上面管道示例中,transform_data步骤需要作为extract_data和generate_schema步骤的输出产生的参数,并且其输出是train_model的依赖项。

你的机器学习代码是被包入组件中的,你可以对组件进行:

- 指定参数——在每次运行时在仪表中可进行编辑,配置。

- 挂载持久卷——如我们的笔记本无故终止,不能添加持久卷的话,我们会丢失全部的数据。

- 指定要生成的工程文件——如方便地存储在Kubeflow仪表板内的Artifact Store中的图形,表格,选择的图片,模型。

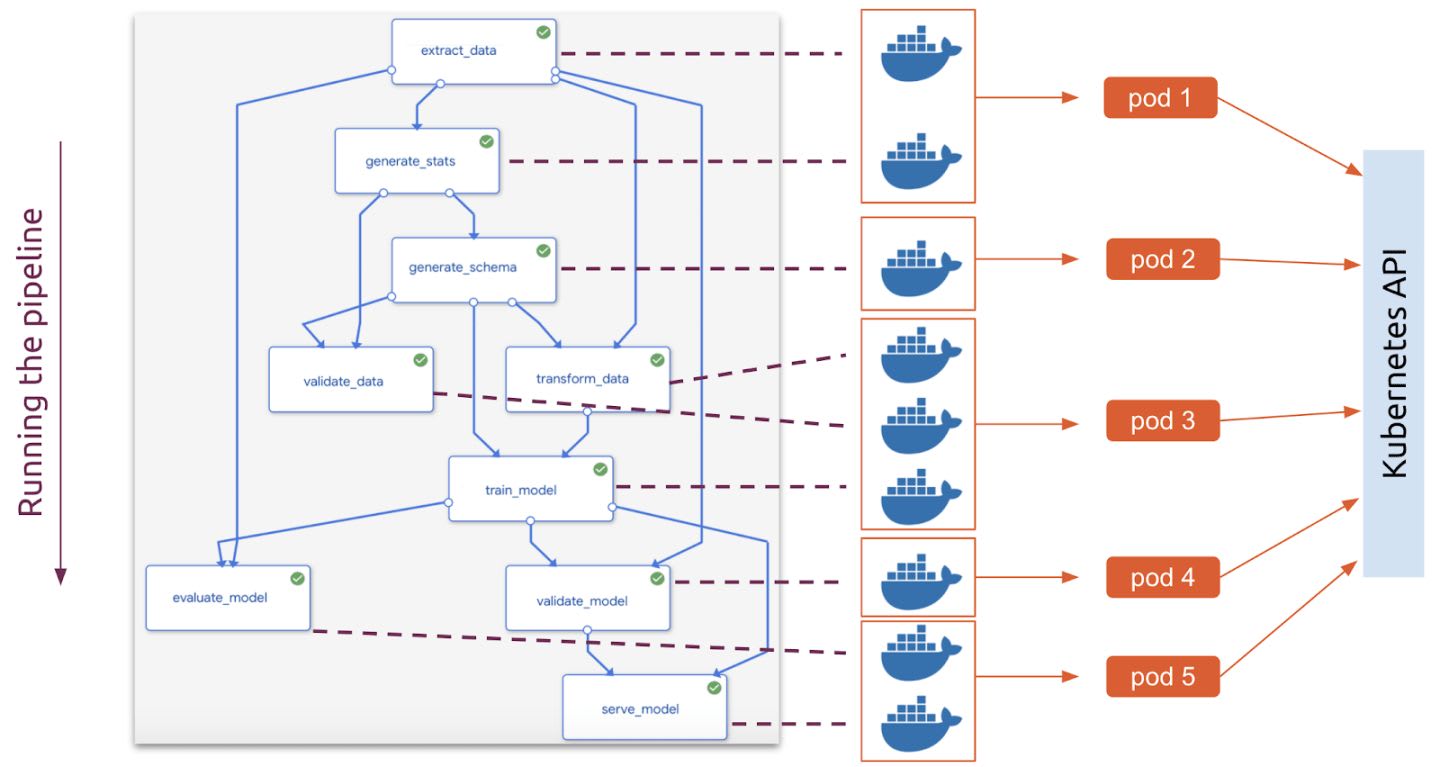

最后,当你运行管道,根据Kubernetes调度,现在将在整个集群中执行每个容器,同时考虑到相关性。

容器化的编排使得其可简单复用,分享或随着工作流程的变化而更换组件,这种情况很常见。

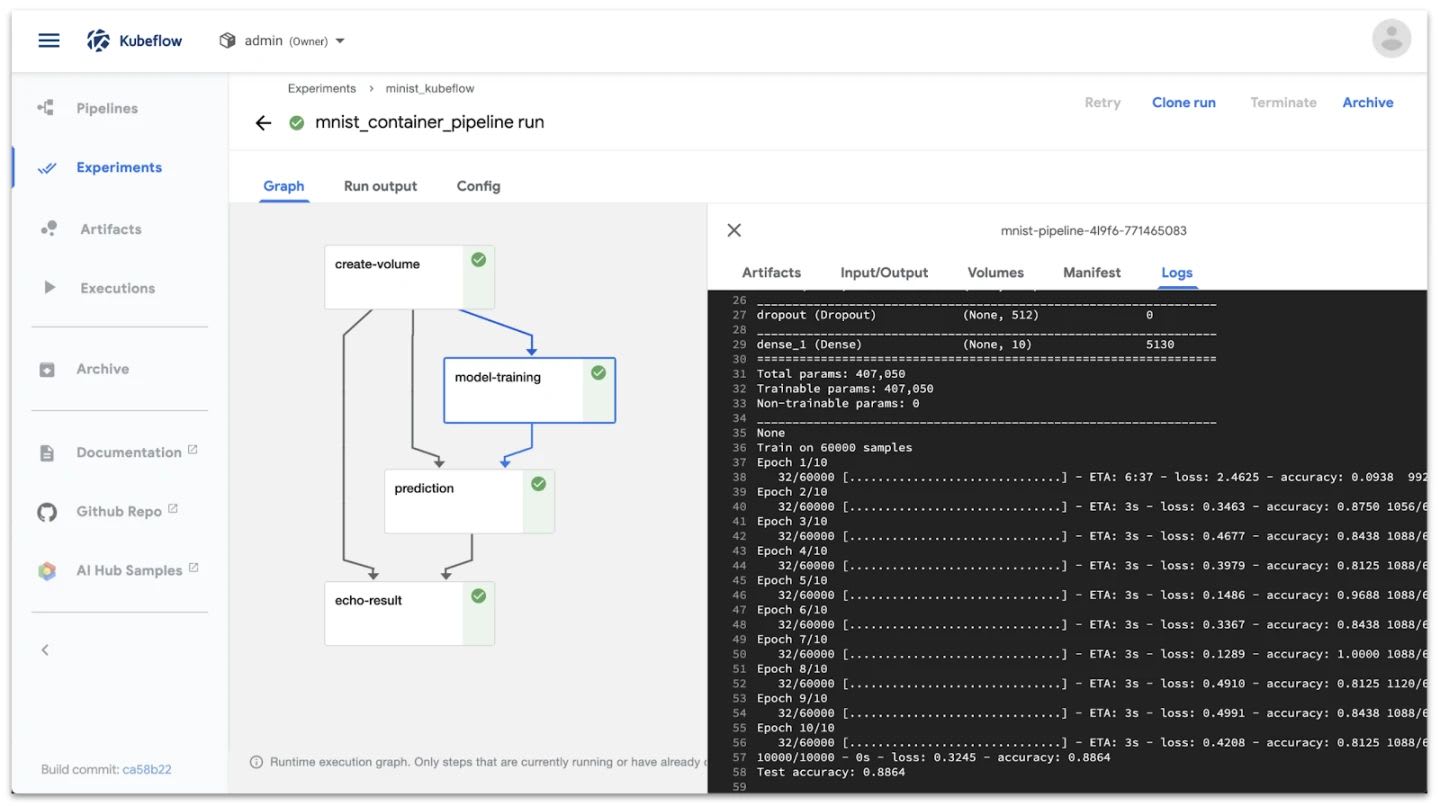

在运行管道后,你能在管道接口上研究结果,调试,调整参数和通过不同参数或数据源执行的管道来进行实验。

通过这样的实验,你保存和比较运行结果,保持最佳性能的模型和工作流程的版本控制。

扩展阅读

要持续学习和实验Kubeflow和Kubeflow管道,你可以:

- 观看我们举办的研讨会

- 尝试运行Github上的Kubeflow示例

- 阅读文章Kubernetes for data science: meet Kubeflow

- 访问ubuntu.com/kubeflow

如何体验Kubeflow?

要在Windows、macOS或者Ubuntu上部署Kubeflow,可参考:

This blog series is part of the joint collaboration between Canonical and Manceps.

Visit our AI consulting and delivery services page to know more.

订阅博客文章

查看更多内容

Canonical 发布针对 Thundercomm RUBIK Pi 3 的最新优化版 Ubuntu 镜像

Ubuntu 现已直接适配 Thundercomm RUBIK Pi 3 开发板——一款专为 AI 开发者打造、搭载高通 Dragonwing™ QCS6490 处理器的轻量型开发板。 Ubuntu 发行商 Canonical 2025 年 10 月 23 日正式宣布,推出针对 RUBIK Pi 3 开发板(一款基于 Dragonwing QCS6490 打造的强大 AI 开发板)的优化预装版 Ubuntu 镜像。此次新推出的优化版 Ubuntu 镜像即开即用,能有效缩短产品上市时间,同时提供 Canonical 官方长期技术支持。当前 RUBIK Pi 3 用户也可下载和安装新版 Ubuntu 镜像。 Ubuntu 提供驱动的快速 AI 开发平台 AI 行业发展瞬息万 […]

对芯片优化过的推理 snap 应用已上线

一条命令即可安装 DeepSeek R1 或 Qwen 2.5 VL 等主流模型并自动获取芯片优化版 AI 引擎。 伦敦,10 月 23 日 — Canonical 宣布推出优化版推理 snap(optimized inference snap),一种在 Ubuntu 设备上部署 AI 模型的全新方式,可基于设备特定芯片自动选择优化版引擎、量化方法及架构配置。目前,Canonical 正与多家芯片提供商合作,为开发者和设备提供主流大语言模型(LLM)的优化版本。 Qwen 2.5 VL、DeepSeek R1 等主流单一模型,往往包含多种尺寸规格与设置配置,且每种配置均针对特定芯片进行了优化。终端用户可能难以判断自身设备适配的模型尺寸与运行时环境,但现在仅需一条命令,即可 […]

Canonical 推出适用于 WSL 的 Ubuntu Pro

适用于 WSL 的 Ubuntu Pro 为 Windows 系统中运行的 Ubuntu 24.04 LTS WSL 实例提供一站式安全维护与企业级技术支持。该订阅服务还能为系统管理员提供全面的管理功能。 今日,Canonical 公司宣布适用于 WSL 的 Ubuntu Pro 服务正式全面上市,用户可通过 Microsoft Store 进行安装。源代码及测试版也可在 GitHub 获取。 Canonical 公司与 Microsoft 建立了良好的合作关系,携手打造优质的 WSL 使用体验。本次合作成果将惠及那些借助 WSL 开发生产级 Linux 解决方案的企业开发者。 Craig Loewen,Microsoft WSL 产品经理 Ubuntu Pro 为桌面端 […]